- TOP

- AI���f�B�A�L��

- AI�̔��f�A�u�Ȃ��H�v�ɓ������܂����HEC���Ǝ҂̂��߂̐����ł���AI�^�p

AI�̔��f�A�u�Ȃ��H�v�ɓ������܂����HEC���Ǝ҂̂��߂̐����ł���AI�^�p

�T�N�b�Ɨ����I�{�L���̗v�_�܂Ƃ�

�u�����ł���AI�v�Ƃ͉��ł����H

AI�̔��f�ɂ��āu�Ȃ������Ȃ������v��l�Ԃ��m�F�E�����ł����Ԃɂ��Ă������Ƃł��B����Z�p�K�������A�u�������L�^����v�u���O���c���v�u�s�K�ȏo�͂�h���v�Ƃ����^�p�̎d�g�݂Â��肪���S�ŁA���m�����Ȃ��Ă����g�߂܂��B

�Ȃ����AEC�T�C�g�^�c��AI�́u�����ӔC�v���d�v�ɂȂ��Ă���̂ł����H

�`���b�g�{�b�g�̌�ē���s�������̌�u���b�N�ȂǁAAI���Ԉ�����Ƃ��Ɂu�Ȃ������Ȃ������v������ł��Ȃ����Ƃ����ƃ��X�N�ɂȂ邽�߂ł��BEU AI�K���@�ȂNjK���������i��ł���A�Ή��̒x�ꂪ�������ЂƂ̍��ɂȂ��肩�˂܂���B

�����ł͋�̓I�ɂǂ�ȏ�ʂŖ𗧂��܂����H

�`���b�g�{�b�g�Ή��E�s���������m�E���R�����h�E���i�摜���ނȂǂŖ𗧂��܂��B�u�ԕi������14���ł��i�o�T�F�ԕi�|���V�[�j�v�̂悤�ɍ������ʼn�����A�s������̗��R��v�f���Ƃɕ������Đ���������ƁA�₢���킹�ւ̑Ή��i�����傫���ς��܂��B

��������Ƃǂ�Ȍ��ʂ�����܂����H

�@��ē��̌�����f��������E���P�ł���A�A�ڋq����̖₢���킹�Ɏ����x�[�X�őΉ��ł���A�B�悭�ԈႦ��p�^�[���͂���AI�̕i�����p�����P�ł���A��3����Ȍ��ʂł��B���X�N�ጸ�����łȂ��APDCA���f�[�^��ՂƂ��Ă��@�\���܂��B

�ʏ��AI�����Ɖ����Ⴂ�܂����H�V�����V�X�e������꒼���K�v������܂����H

�V�V�X�e���ւ̒u�������ł͂Ȃ��A������AI�Ɂu�����E�L�^�E���S��v�������邱�Ƃł��B�����̃v���b�g�t�H�[���ɂ̓��O�@�\��t�B���^�[�����łɔ�����Ă���A�ݒ��L�������邾���őΉ��ł���ꍇ����������܂��B�ڋq�ւ̉e�����傫�����f����D��I�ɐ�������̂������I�ł��B

�{�y�[�W�ł͐���AI�Ő��������摜�𗘗p���A��������������H���Ă��܂��B

AI���u���R�������Ȃ��v���� ���ꂪEC���Ƃ̃��X�N�ɂȂ�

�uAI�`���b�g�{�b�g��������A���q�l�Ή����������ł����v�u���R�����h�G���W���ŋq�P�����オ�����v����AI�̓������ʂ��������Ă���EC���Ǝ҂͑����Ă��܂��B

�������A����ȏ�ʂ�z�����Ă݂Ă��������B

- �`���b�g�{�b�g���u���̏��i��30���ԕԕi�\�ł��v�ƈē��������A���ۂ̋K���14���Ԃ������B�Ȃ��ԈႦ���̂��A�N�ɂ�������Ȃ��B

- �s���������mAI���A��A�̂����ӗl�̒������u���b�N�����B�Ȃ��u�s���v�Ɣ��肳�ꂽ�̂��A�S���҂ɂ������ł��Ȃ��B

- ���R�����h�G���W���������Ⴂ�̏��i���������߂��āA�N���[�����������B�Ȃ����̏��i���I�ꂽ�̂��A�N���m�F�ł��Ȃ��B

�����ɋ��ʂ�����́AAI���ԈႤ���Ǝ��̂ł͂Ȃ��A�Ԉ�����Ƃ��Ɂu�Ȃ������Ȃ������v���m�F���������ł��Ȃ������ł��B

���ۂ�2024�N�A�J�i�_�ł�Air Canada�̌����T�C�g�̃`���b�g�{�b�g���A���ۂɂ͔F�߂��Ă��Ȃ��������^���̎���\�����\�ł��邩�̂悤�Ɉē��������Ƃ����ɂȂ�܂����B�u���e�B�b�V���R�����r�A�B�̕��������@�ւ́A�`���b�g�{�b�g���E�F�u�T�C�g�̈ꕔ�ł���Ƃ��āA���ЂɐӔC������Ɣ��f���Ă��܂��B

�܂�2023�N�ɂ́A�č��̃V�{���[�̔��X�̃`���b�g�{�b�g���A���[�U�[�̍H�����w���ɂ���Ĉ�E�������������A���̃X�N���[���V���b�g��SNS�ő傫���g�U����鎖�ԂɂȂ�܂����B

�����͂ǂ�����uAI�̔��f��ɑ�������E�Ǘ��̑̐����Ȃ������v���ƂɋN�����Ă��܂��B�����������Ԃ�h�����߂ɁAEC���Ǝ҂�����������g�߂�����I�ȃA�v���[�`�����Ă����܂��傤�B

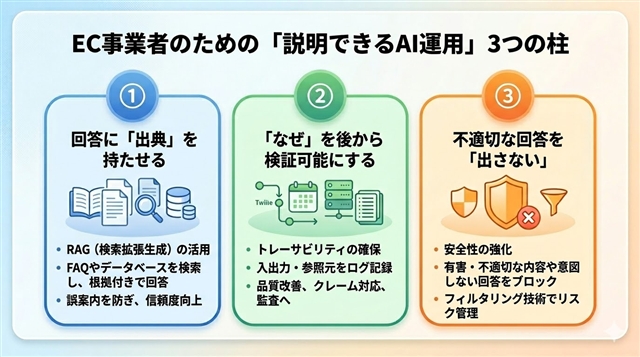

EC���Ǝ҂���������n�߂���u�����ł���AI�^�p�v3�̒�

AI���u�����ł���v��Ԃʼn^�p���邽�߂ɁA���H���ׂ����Ƃ͑傫��3�ɏW��܂��B�����ȁE�o�ώY�ƏȂ�AI���Ǝ҃K�C�h���C���i2025�N3������ v1.1�j�ł��A�������E�A�J�E���^�r���e�B�E���S�����d�v�Ȏw�j�Ƃ��Ď�����Ă���A�{�L���ŏЉ��3�̒��͂��̎�|��EC�����ɗ��Ƃ������̂ł��B

�@ AI�̉Ɂu�o�T�v����������

AI���u���������ɂ��̉���������v�����m�ł��邱�Ƅ������ꂪ�ŏ��ɐ�����ׂ��|�C���g�ł��B�������s���Ȃ܂܌�����ē�������A�N���[���ɒ������܂��B

�������������̂�RAG�i�����g�������j�Ƃ����d�g�݂ł��BAI���O�Ɏ��Ђ�FAQ�⏤�i�f�[�^�x�[�X���������A�q�b�g�������͈͓̔��ʼn����܂��B�u�ԕi�����͏��i������14���ȓ��ł��i�o�T�F�ԕi�|���V�[ v2.1�j�v�̂悤�ɍ����t���ʼnł��邽�߁A��ē��̖h�~�ƈ��S���̌���ɂȂ���܂��B�����������ē����������Ă��A�o�T���m�F���邾���Ō�����f��������ł��A���P���ׂ��|�C���g�����m�ɂȂ�܂��B

��v��AI�v���b�g�t�H�[���ł́ARAG�\���̃`���b�g�{�b�g�\�z�@�\��A���Q�ƌ��ɉ����Ă��邩���������肷��@�\������Ă��܂��B

�A �u�Ȃ��������������v���ォ�猟�ł���悤�ɂ���

AI�����A�N�ɁA���������ɁA���Ɖ��������L�^���A�ォ��m�F�ł��邱�ƁB�K�C�h���C���ł��u�������v�u�A�J�E���^�r���e�B�v�Ƃ��ďd������Ă���l�����ł��B���q�l����u�`���b�g�{�b�g�Ɂw�ɂ���x�ƌ���ꂽ�̂ɕi�ꂾ�����v�Ɛ\�����������Ƃ��A���O������Ύ����x�[�X�őΉ��ł��܂����A�Ȃ���ΐ��|���_�ɂȂ�܂��B

���O������A���q�l����̐\���Ɏ����x�[�X�őΉ��ł��AAI���悭�ԈႦ�鎿��p�^�[���̕��͂�ABtoB EC�Ŏ���悩�狁�߂���AI���p�̐����ȂǁA�i�����P����č��Ή��܂ŕ��L�����p�ł��܂��B

������AI�v���b�g�t�H�[���ł̓��O�@�\���p�ӂ���Ă��܂����A�����ݒ�ł͖����̏ꍇ������܂��B�������Ƀ��O�̗L�����ƌl���̎�舵�����[�����m�F���Ă����܂��傤�B

�B �s�K�ȉ��u�o���Ȃ��v�d�g�݂�����

AI���L�Q�E�s�K�ȉ�����̂����O�ɖh�~���邱�ƁB�K�C�h���C���́u���S���v�ɂ�����̈�ŁA�u�������K�v�Ȏ��́v�������������炷���̎d�g�݂ł��B��́u���ӂ�����͂̃u���b�N�v�u�o�͂̃t�B���^�����O�v�u�Ɩ����[���ɂ�鐧��v��3�w�ōl���܂��B

���Ƃ��Ή��ϕiEC�Łu���̏��i�Ńj�L�r�͎���܂����H�v�ƕ����ꂽ�Ƃ��AAI����Ì��ʂ�f������Ɩ�@�@��̖��ɂȂ肩�˂܂���B���O�w���Łu��Ì��ʂ̒f��͂��Ȃ��v�Ɛ��A�t�B���^�Ō��o����̐�����邱�ƂŖh���܂��B��������3�w�̖h�䂪�Ȃ���A�s�K�ȉ̔��o��SNS�g�U��ɂȂ肪���ł����A���O�Ɏd�g�݂𐮂��Ă������ƂŃ��X�N��啝�ɒጸ�ł��܂��B��v��AI�v���b�g�t�H�[���ł́A�R���e���c�t�B���^�����O�∫�ӂ���v�����v�g�̌��o�@�\���W���I�ɒ���Ă��܂��B

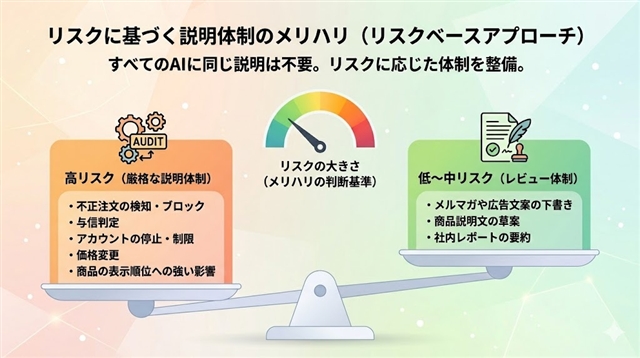

���ׂĂ�AI�ɓ������x���́u�����v�͕K�v�H�������X�N�ɉ����������n��

���ׂĂ�AI�ɓ��������̐����̐��͕K�v����܂���B��Ȃ̂́AAI���������f�̃��X�N�̑傫���ɉ����ă����n�������邱�Ƃł��B

�����̐��̗D��x�������P�[�X�i�����X�N���f�j�F�s�������̌��m�E�u���b�N�A�^�M����A�A�J�E���g�̒�~�E�����A���i�ύX�A���i�̕\�����ʂւ̋����e�����������͌�肪�������Ƃ��Ɂu�Ȃ��H�v�ւ̐��������߂����ʂł��B

���r���[�̐��ŏ\���ȃP�[�X�i��〜�����X�N�j�F�����}�K��L�����Ẳ������A���i�������̑��āA�Г����|�[�g�̗v�������͐l�Ԃɂ�郌�r���[�E���F�̃v���Z�X������ق������ʓI�ł��B

�Ȃ��AAI���Ǝ҃K�C�h���C�� v1.1�ł��A���X�N�̑傫���ɉ����đ�̒��x��ς���u���X�N�x�[�X�A�v���[�`�v����{�I�ȍl�����Ƃ���Ă��܂��B

�܂��͎��Ђ�AI���p��I�������āA�u���̔��f���Ԉ�����Ƃ��A�ڋq������ɐ��������߂��邩�H�v�Ƃ�����ŗD�揇�ʂ����邱�Ƃ������ł��B

�`���b�g�{�b�g�����ł͂Ȃ�����AI�́u�Ȃ��H�v�ɓ�����Z�p

�����܂ł�3�̒��́A���AI�`���b�g�{�b�g��z�肵�Ă��܂����B������EC���Ƃł́A�s�������̌��m�A���i���R�����h�A���i�摜�̎������ނȂǁA�`���b�g�{�b�g�ȊO�ɂ����܂��܂�AI�����Ă��܂��B

���������̈�̗����Ŋ��p���L�����Ă���̂��AXAI�iExplainable AI�F�����\��AI�j�ƌĂ��AI�̔��f���R��l���������₷�����邽�߂̋Z�p�ł��B���Ă͐��I�Ȓm�����Ȃ���Έ����܂���ł������A�ŋ߂ł̓N���E�h�T�[�r�X��SaaS�Ɂu�����@�\�v�Ƃ��ĕW�����ڂ����悤�ɂȂ�AEC���Ǝ҂��ӎ������Ƃ����̉��b�����������������܂��B

�ȉ��ŏЉ��s���������m�E���R�����h�E���i�摜���ނ̎���́A�����������XAI�̋Z�p�������Ɋ�������Ă����̗�ł��B

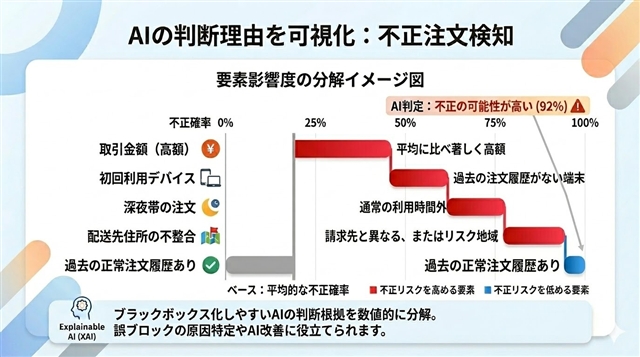

�s���������m�����u�Ȃ��u���b�N�������v������

�s���������m�ł́A�����f�[�^�i���z�A���ԑсA�z����Ȃǁj�����ƂɁu�s���̊m���v���Z�o����AI���L���g���Ă��܂��B���́A�����Ȓ���������ău���b�N�����Ƃ��A�u�Ȃ��s���Ɣ��肵�����v���u���b�N�{�b�N�X�ɂȂ肪���Ȃ����ł��B

�����Ŗ𗧂̂��AXAI�̋Z�p�̂ЂƂł���u���茋�ʂɑ��āA�ǂ̗v�f���ǂꂾ���e���������v�����Ď�����@�ł��B�u������z�̉e�����傫���A�����ŏ��߂Ďg���f�o�C�X�A�[��т̒���������ɉe�������v�Ƃ������`�ŁA�e�v�f�̊�^���������ƂŁA�Ȃ����̒��������X�N���Ɣ��f���ꂽ�̂���l���������₷���Ȃ�܂��B

���������e���v�f�̕���������A��u���b�N���ɂ������Ɋ�Â���������������f���\�ɂȂ�܂��BEC�����s�����m�T�[�r�X�̒��ɂ́A���藝�R�̕����E�����@�\������Ă�����̂�����܂��B�T�[�r�X�I�莞�Ɋm�F���Ă݂Ă��������B

���R�����h�G���W�������u�Ȃ��������߂������v��`����

�u�Ȃ����ꂪ�����ɂ������߂Ȃ̂��v���킩��ƁA���[�U�[�̎�e�������܂�₷�����Ƃ������̌����Ŏ�����Ă��܂��B�u�ŋ߂����ɂȂ��������j���O�V���[�Y�Ɠ����u�����h�̐V��ł��v�������������������������ŁA���R�����h�̐M�����͑傫���ς��܂��B���E���R������邱�ƂŁA���[�U�[�̔[���������シ�邾���łȂ��A�I�O��Ȃ������߂��o���ۂ̌������͂���P�̎肪����ɂ��Ȃ�܂��B�����ł�XAI�̋Z�p�����p����Ă���AEC�v���b�g�t�H�[����R�����h�T�[�r�X�̒��ɂ́A���E���R�������E����@�\���������̂�����܂��B

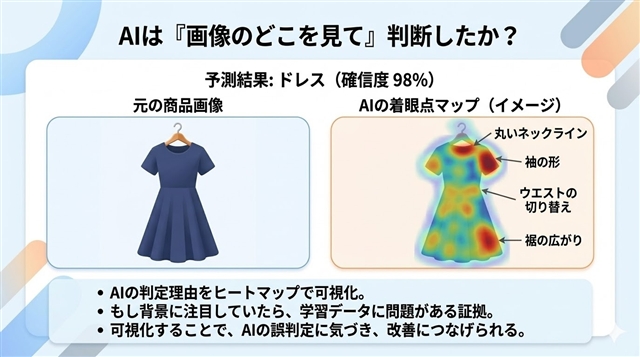

���i�摜���ބ����u�摜�̂ǂ����������v����������

�A�p����EC��H�iEC�ł́A���i�摜��AI�Ŏ������ނ���P�[�X�������Ă��܂��B���������摜�F��AI�ɑ��Ă��AXAI�̋Z�p�����p����Ă��܂��B�u�摜�̂ǂ̕��������Ĕ��f�������v���q�[�g�}�b�v�ʼn��������@������AAI�����ڂ����̈��F�̔Z�W�ŕ\���ł��܂��B

�� �}�FAI�́u����_�}�b�v�v�̗��i���F���̏��i�摜�@�E�FAI�����ڂ����̈���q�[�g�}�b�v�ʼn����B���q�[�g�}�b�v��AI�����ɒ��ڂ����̈�������C���[�W�ł��B�j

���̗�ł́AAI�������s�[�X��98%�̊m�M�x�Łu�h���X�v�Ɣ��肵�Ă��܂��B�q�[�g�}�b�v������ƁA�ۂ��l�b�N���C���A���̌`�A�E�G�X�g�̐�ւ��A���̍L����Ƃ������ߕ��̍\���I�ȓ����ɒ��ڂ��Ă��邱�Ƃ��킩��܂��B�������ꂪ���i�{�̂ł͂Ȃ��w�i�ɒ��ڂ��Ĕ��肵�Ă�����A�w�K�f�[�^�ɖ�肪����؋��ł��B�����������������邱�ƂŁAAI�̌딻��ɋC�Â��A���P�ɂȂ��邱�Ƃ��ł��܂��B

���v�\���E�����\�������u�Ȃ����̐��l�ɂȂ������v���{��̍����ɂ���

EC�ł͎��v�\����ڋq�̗����\���ɂ�AI�����p����Ă��܂����A�\�����ʂ̐��l����������A�u�Ȃ����̗\���ɂȂ����̂��v�������ł��Ȃ��P�[�X�͏��Ȃ�����܂���BXAI�̉e���x�����̎�@��K�p����A�ǂ̗v�f�i�G�ߐ��A�ߋ��̍w���p�x�A���߂̃T�C�g�K��Ԋu�Ȃǁj���\���ɑ傫���e����������������A�{�����Ă̍����Ƃ��Ċ��p�ł���悤�ɂȂ�܂��B

�m���Ă��������K���̓���

AI�̐����\���Ɋւ���K���́A�����O�ŋ}���ɐ�������Ă��܂��B

EU��AI�K��

EU AI�K���@�iAI Act�j�͒i�K�I�ɓK�p���i��ł���A�`���b�g�{�b�g�Ȃǐl�ƒ��ڂ���肷��AI�ɂ��ẮA���p�҂�AI�ƑΘb���Ă��邱�Ƃ�m�点�铧�����`�����݂����Ă��܂��B��v�ȓ��������[����2026�N8������K�p�\��ŁAEU�����z��EC��W�J���鎖�Ǝ҂ɂ��e�������܂��B

���{ AI���Ǝ҃K�C�h���C�� v1.1�i2025�N3�������j

�@�I�S���͂͂���܂��A�l�Ԓ��S�E���S���E�������E�v���C�o�V�[�ی�E�Z�L�����e�B�m�ہE�������E�A�J�E���^�r���e�B�Ȃ�10�̋��ʎw�j��������Ă��܂��B���Ɂu�������v�̒��ɂ͔��f�����̃��O�L�^�i���؉\���j��X�e�[�N�z���_�[�ւ̐����\�����A�u�A�J�E���^�r���e�B�v�̒��ɂ̓f�[�^��ӎv����̒ǐՉ\���i�g���[�T�r���e�B�j���܂܂�Ă���A�{�L����3�̒��ƑΉ�����\���ł��B

NIST AI RMF�i��j

�u�����\���Ɖ��߉\���v��M���ł���AI�̏d�v�ȓ����Ƃ��Ĉʒu�Â��Ă��܂��B�č��s�������EC���Ǝ҂͎Q�Ƃ��ׂ��t���[�����[�N�ł��B

��������A�uAI�̔��f�ɍ������������A�L�^���c���A���S�����m�ۂ���v�Ƃ������ʂ̕������������Ă��܂��B

�܂Ƃ߄����uAI������ł���`�Ŏg���Ă���v���M��������

EC���Ǝ҂ɂƂ��Ė{���ɏd�v�Ȃ̂́AAI�̓����\�������S�ɗ������邱�Ƃł͂���܂���B�딻��₨�₢���킹���N�����Ƃ��ɁA�������m�F���A�K�v�Ȃ�l���C�����A�Г��O�ɐ����ł����Ԃ���邱���������ꂪ�u�����ł���AI�^�p�v�̖{���ł��B

�܂��͎��Ђ�AI���p�ɂ��āA����3���m�F����Ƃ��납��n�߂Ă݂Ă��������B

- �����������邩�H���� AI�̉ɎQ�ƌ����\������Ă��邩

- �L�^��ǂ��邩�H���� �����̃��O�͋L�^����Ă��邩

- �댯��h���Ă��邩�H���� �s�K�ȉ�h���t�B���^�͐ݒ肳��Ă��邩

AI���p�̋�������������Ȃ��ŁA�uAI���g���Ă���v���Ǝ��͍̂��ʉ��ɂȂ�Ȃ��Ȃ����܂��B���ꂩ����uAI�̔��f������ł���`�Ŏg���Ă���v���Ƃ��A�ڋq����̐M���Ǝ��Ƃ̎����\�����x����y��ɂȂ�͂��ł��B

AI�́u�����ӔC�v��EC�v���b�g�t�H�[�����S���ׂ������

�`���b�g�{�b�g��R�����h�ȂǁAAI���ւ��@�\�ЂƂЂƂɐ����̐��𐮂��Ă����̂́A�e�Ղł͂���܂���B

ecbeing�́AAI�����p����EC��Ղ������X�g�b�v�Œ��A�uAI�̔��f������ł����ԁv���v���b�g�t�H�[�����Ōp���I�Ɏx���܂��B���Ǝ҂��{�����͂��ׂ����i�Â���ƌڋq�̌��ɏW���ł���悤�A�L�x�ȓ������т����Ƃɔ������܂��B

�_ EC�T�C�g�̍\�z�E���j���[�A���̂����k�͂����炩�� �^

���₢���킹�t�H�[��